NVIDIA NIM

利用 NVIDIA NIM 微服务加速您的 AI 部署

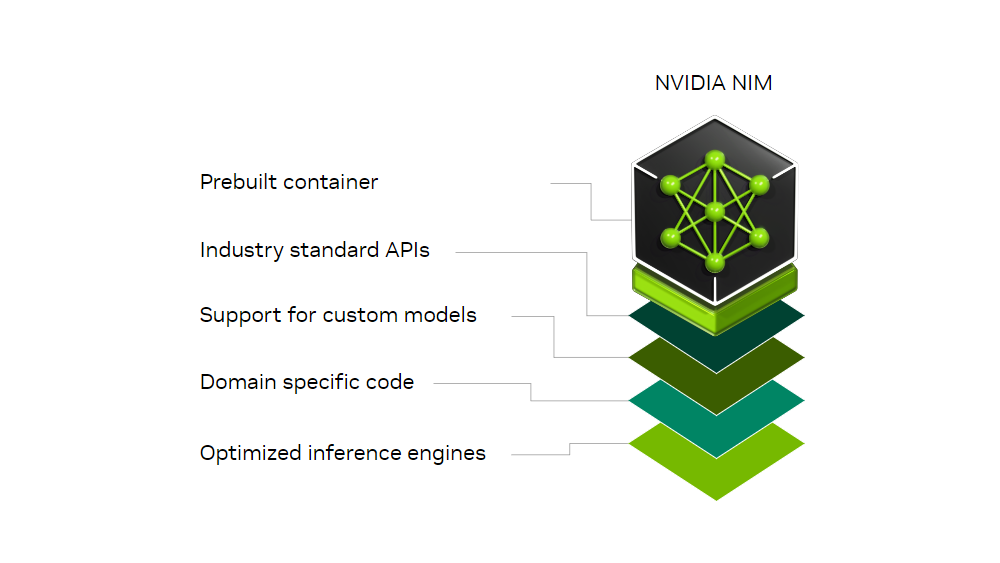

NVIDIA NIM 微服务是 NVIDIA AI Enterprise 的一部分,是一组易于使用的微服务,旨在加速在任何云或数据中心部署基础模型,并帮助确保您的数据安全。NIM 微服务具有生产级运行时,包括持续的安全更新。通过企业级支持的稳定 API 运行您的业务应用程序。

NVIDIA NIM 微服务旨在弥合复杂的 AI 开发世界与企业环境的运营需求之间的差距,使 10-100 倍的企业应用程序开发人员能够为公司的 AI 转型做出贡献。

用于客户服务的数字人 NVIDIA AI Blueprint 由 NVIDIA Tokkio 提供支持,Tokkio 是一个基于 ACE 技术的workflow,通过 3D 动画数字人界面将企业应用程序变为现实

快速摄取海量 PDF 文档。提取文本、图表、曲线图和表格,实现高度准确的检索。

用于生成式虚拟筛选的 NVIDIA BioNeMo Blueprint 展示了如何使用生成式 AI 和加速的 NIM 微服务来更智能、更快速地设计优化的的小分子。

最新版本

一种广泛使用的模型,用于根据蛋白质的氨基酸序列预测其 3D 结构。

AlphaFold2 是 Google DeepMind 的蛋白质结构预测模型。AlphaFold2 在预测氨基酸序列的蛋白质结构方面表现出最先进的性能,优于蛋白质结构预测关键评估 (CASP) 中的所有其他提交。

MolMIM 是 NVIDIA 开发的基于 Transformer 的模型,用于受控小分子生成。MolMIM 优化并从潜在空间中采样分子,并以用户定义的评分函数为指导,包括来自其他模型的函数和基于各种化学和生物学特性的实验数据测试的函数。MolMIM 可以部署在云端或本地,用于计算药物发现工作流程中的企业级推理,包括虚拟筛选、先导化合物优化和其他实验室循环方法。

NVIDIA GenMol NIM 是一种基于 BERT 的通用 AI 模型,旨在通过生成和优化分子结构来简化药物发现。它有助于执行各种与受控分子生成和小分子多参数优化相关的任务,并使用用户定义的 oracle,使研究人员能够根据特定需求定制分子创建。NVIDIA GenMol 可以部署在本地或任何云服务提供商上,用于药物发现工作流程中的企业级推理,包括虚拟筛选和先导化合物优化。

ProteinMPNN(蛋白质消息传递神经网络)是一种基于深度学习的图神经网络,旨在预测给定蛋白质骨架的氨基酸序列。该网络利用进化、功能和结构信息来生成可能折叠成所需 3D 结构的序列。

RFdiffusion (RoseTTAFold Diffusion) 是一种强大的深度学习模型,旨在生成新型蛋白质结构和复合物。

NVIDIA DiffDock NIM 专为企业级高性能、可扩展的分子对接而构建。它需要蛋白质和分子 3D 结构作为输入,但不需要有关结合口袋的任何信息。在生成式 AI 模型和加速的 3D 等变图神经网络的驱动下,DiffDock 每秒预测的姿势比基准发布模型多 7.6 倍,从而降低了计算药物发现工作流程的成本,包括虚拟筛选和先导化合物优化。

NVIDIA NIM Audio2Face-3D (A2F-3D NIM) 基于音频和情感输入提供最先进的生成式 AI 头像动画解决方案。它是 NVIDIA ACE 的核心组件,支持创建智能、情感丰富的数字人。凭借对实时语音到面部动画和情感驱动的表情的支持,A2F-3D NIM 为游戏、虚拟助手、教育等领域的交互式、栩栩如生的数字人提供动力。

最新版本

Correction Diffusion (CorrDiff) 是一种生成式 AI 模型,可缩小表面和大气变量,以提高天气数据的准确性和分辨率。CorrDiff 是一种两步方法,其中平均机器学习模型通过另一个扩散模型进行校正。CorrDiff 表现出熟练的确定性和概率性预测,并忠实地恢复极端情况的光谱和分布。

FourCastNet (FCN) NIM 以 6 小时的时间步长预测准确的短期到中期全球预测,预测稳定性超过模拟时间一年(1,460 步),同时保留物理上合理的动力学。多变量预测包括地表和大气变量,例如不同垂直高度的风速、温度和压力。

最新版本

用于 LLM 的 NIM 使 IT 和 DevOps 团队可以轻松地在他们自己管理的环境中自托管大型语言模型 (LLM),同时仍为开发人员提供行业标准 API,使他们能够构建强大的副驾驶、聊天机器人和 AI 助手,从而转变他们的业务。

资源

本文档深入介绍了如何对大型语言模型 (LLM) 的部署进行基准测试、常用指标和参数,以及分步指南。

以前的版本

用于 LLM 的 NIM 使 IT 和 DevOps 团队可以轻松地在他们自己管理的环境中自托管大型语言模型 (LLM),同时仍为开发人员提供行业标准 API,使他们能够构建强大的副驾驶、聊天机器人和 AI 助手,从而转变他们的业务。

用于 LLM 的 NIM 使 IT 和 DevOps 团队可以轻松地在他们自己管理的环境中自托管大型语言模型 (LLM),同时仍为开发人员提供行业标准 API,使他们能够构建强大的副驾驶、聊天机器人和 AI 助手,从而转变他们的业务。

用于 LLM 的 NIM 使 IT 和 DevOps 团队可以轻松地在他们自己管理的环境中自托管大型语言模型 (LLM),同时仍为开发人员提供行业标准 API,使他们能够构建强大的副驾驶、聊天机器人和 AI 助手,从而转变他们的业务。

用于 LLM 的 NIM 使 IT 和 DevOps 团队可以轻松地在他们自己管理的环境中自托管大型语言模型 (LLM),同时仍为开发人员提供行业标准 API,使他们能够构建强大的副驾驶、聊天机器人和 AI 助手,从而转变他们的业务。

最新版本

Maxine 眼神交流模型估计输入眼神注视的方向,并使用眼睛周围的感兴趣区域(称为眼贴)合成重定向的眼神注视。

Studio Voice NIM 利用最先进的 AI 模型来增强通过嘈杂和混响环境中的低质量麦克风录制的输入语音,使其达到录音棚录音质量的语音。此 NIM 支持 3 种模式 - 48kHz 输入的质量模式、16kHz 输入的质量模式和 48kHz 输入的低延迟模式。

最新版本

NVIDIA MAISI(用于合成成像的医疗 AI)是一种最先进的三维 (3D) 潜在扩散模型,旨在生成具有或不具有解剖注释的高质量合成 CT 图像。此 AI 模型擅长数据增强和创建逼真的医学成像数据,以补充因隐私问题或罕见疾病而受到限制的数据集。它还可以通过生成多样化且逼真的训练数据,显着提高其他医学成像 AI 模型的性能。

VISTA-3D 是一种专门的交互式基础模型,用于 3D 医学成像。它擅长在不同解剖结构和模态中提供准确且适应性强的分割分析。VISTA-3D 利用多头架构来适应不同的条件和解剖区域,帮助指导用户的注释工作流程。

最新版本

NVIDIA NIM 为多模态安全模型提供预构建的容器,这些容器可用于保护 AI 应用程序或任何需要理解和生成多模态内容的应用程序。

基于预定义的策略,在对话式生成 AI 应用程序中保持主题相关性。

增强 LLM 应用程序的安全性和审核能力。

通过对用户提示进行分类和评分以查找不安全的输入,增强您的 LLM 应用程序以抵御越狱尝试。

最新版本

NVIDIA NeMo™ Retriever 文本嵌入 NIM 微服务将最先进的文本嵌入模型的功能带入您的应用程序,提供无与伦比的自然语言处理和理解能力。您可以将 NeMo Retriever 嵌入 NIM 微服务用于语义搜索、检索增强生成 (RAG) 或任何使用文本嵌入的应用程序。NeMo Retriever 文本嵌入 NIM 微服务构建于 NVIDIA 软件平台之上,集成了 NVIDIA® CUDA®、TensorRT™ 和 Triton™ Inference Server,可提供开箱即用的 GPU 加速。

NVIDIA NeMo™ Retriever 文本重排序 NIM 微服务根据引文与查询的匹配程度对其进行重新排序。这是检索过程中的关键步骤,特别是当检索管道涉及来自不同数据存储的引文时,每个数据存储都有自己的相似性度量算法。

资源

企业拥有等待被利用的金矿数据,这些数据可用于提高效率、节省资金并最终提高生产力。借助生成式 AI,开发人员可以构建和部署代理流程或检索增强生成 (RAG) 聊天机器人,同时确保提供的见解基于最准确和最新的信息。

生成式 AI 应用程序如果没有准确性,价值很小,有时甚至会产生负面价值——而准确性植根于数据。

为了帮助开发人员有效地获取最佳专有数据,从而为他们的 AI 应用程序生成知识渊博的响应,NVIDIA 今天宣布推出四个新的 NVIDIA NeMo Retriever NIM 推理微服务。

为了帮助开发人员有效地获取最佳专有数据,从而为他们的 AI 应用程序生成知识渊博的响应,NVIDIA 今天宣布推出四个新的 NVIDIA NeMo Retriever NIM 推理微服务。

采用检索增强生成 (RAG) 是确保大型语言模型 (LLM) 响应是最新的且非幻觉的有效策略。

虽然各种检索策略可以提高生成文档的召回率,但没有一种万能的方法。检索管道取决于您的数据,从分块大小和返回的文档数量等超参数,到语义搜索或图检索等检索算法。

虽然各种检索策略可以提高生成文档的召回率,但没有一种万能的方法。检索管道取决于您的数据,从分块大小和返回的文档数量等超参数,到语义搜索或图检索等检索算法。

寻求利用 AI 力量的企业需要根据其特定行业需求量身定制的定制模型。

NVIDIA AI Foundry 是一项服务,使企业能够使用数据、加速计算和软件工具来创建和部署定制模型,从而为他们的生成式 AI 计划提供强大的动力。

NVIDIA AI Foundry 是一项服务,使企业能够使用数据、加速计算和软件工具来创建和部署定制模型,从而为他们的生成式 AI 计划提供强大的动力。

最新版本

NVIDIA NIM for NV-CLIP 基础模型,用于图像和文本嵌入生成。

最新版本

NVIDIA Riva 自动语音识别 (ASR) NIM 微服务提供创纪录的英语语言转录。它们提供卓越的准确性和稳健性,能够熟练地处理各种语音模式和噪声水平。它们使企业能够推进其基于语音的服务,确保卓越的用户体验。

NVIDIA Riva Megatron 神经机器翻译 (NMT) NIM 通过利用在包含数百万并行句子的公开可用数据集上的广泛训练,提供准确的实时翻译。这种前沿的翻译 NIM 使组织能够将多语言翻译无缝集成到其生成式 AI 管道中,从而扩大其全球影响力、吸引不同的受众并加强国际合作。

NVIDIA Riva 文本到语音 (TTS) NIM 微服务集成了 FastPitch 和 HiFiGAN 模型,可从文本生成高保真语音。它们使企业能够创建听起来自然的语音,提升用户参与度并提供沉浸式体验,从而为语音质量树立新标准。

最新版本

NVIDIA NIM for Vision Language Models (VLMs) (NVIDIA NIM for VLMs) 将最先进的视觉语言模型 (VLM) 的强大功能带入企业应用程序,提供无与伦比的自然语言处理以及图像和视频理解能力。

在 Kubernetes 中操作和管理用于运行 LLM、嵌入和其他 NIM 微服务和模型的软件组件和服务的生命周期。

NVIDIA NIM 是 NVIDIA AI Enterprise 软件平台的一部分,可在 Google Cloud Marketplace 上获得,是一组易于使用的微服务,旨在安全、可靠地部署高性能 AI 模型推理,现在已与 Google Kubernetes Engine (GKE) 集成,GKE 是一种托管式 Kubernetes 服务,用于使用 Google 的基础设施大规模部署和运营容器化应用程序。NIM on GKE 简化了 AI 推理工作负载的部署和管理。它利用 GKE 的强大功能和 NVIDIA 在 Google Cloud 上的全栈 AI 平台,为 AI 模型推理提供强大而灵活的解决方案。