NVIDIA DGX 平台

NVIDIA DGX 平台融合了 NVIDIA 最佳的软件、基础设施和专业知识,打造了一个现代化的统一 AI 平台,横跨云端和本地部署。

NVIDIA Base Command 为 DGX Cloud 和每个 NVIDIA DGX 系统提供支持,交付 NVIDIA 最佳的软件创新成果,从而更快、更轻松、更经济高效地实现 AI 基础设施的投资回报率。

NVIDIA Base Command Manager 简化了集群配置、工作负载管理和基础设施监控。它提供了部署和管理 AI 数据中心所需的所有工具。NVIDIA Base Command Manager Essentials 包含了 NVIDIA Base Command Manager 中经过 NVIDIA AI Enterprise 认证的功能。

领导级的 AI 基础设施,适用于从 AI 数据中心到 AI 超级计算机的本地和混合部署。

NVIDIA DGX SuperPOD 的部署和管理指南,DGX SuperPOD 是一个 AI 数据中心基础设施平台,使 IT 部门能够为每个用户和工作负载交付毫不妥协的性能。DGX SuperPOD 为最具挑战性的 AI 和高性能计算 (HPC) 工作负载提供领导级的加速基础设施和敏捷、可扩展的性能,并具有经过行业验证的成果。

DGX BasePOD 的部署和管理指南,DGX BasePOD 为企业提供规范性的 AI 基础设施,消除了传统上与扩展 AI 基础设施相关的设计挑战、漫长的部署周期和管理复杂性。

NVIDIA MAGNUM IO™ 软件开发工具包 (SDK) 使开发人员能够消除 AI、高性能计算 (HPC)、数据科学和可视化应用中的输入/输出 (IO) 瓶颈,从而缩短其工作流程的端到端时间。Magnum IO 涵盖了虚拟化、容器化和裸机环境中 CPU、GPU、DPU 和存储子系统之间数据移动的所有方面。

NVIDIA NGC 是 GPU 优化软件的中心,适用于深度学习、机器学习和 HPC,它提供容器、模型、模型脚本和行业解决方案,以便数据科学家、开发人员和研究人员可以专注于构建解决方案并更快地收集见解。

NVIDIA 优化框架(如 Kaldi、NVIDIA 优化深度学习框架(由 Apache MXNet 提供支持)、NVCaffe、PyTorch 和 TensorFlow(包括 DLProf 和 TF-TRT))在设计和训练用于机器学习和 AI 应用的自定义 DNN 时提供了灵活性。

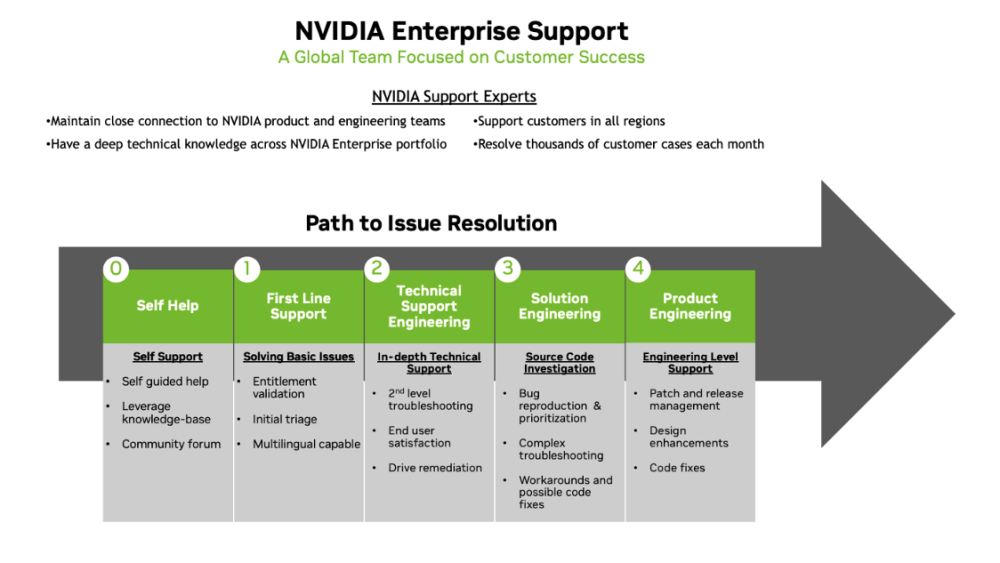

NVIDIA 企业支持与服务指南提供了有关使用 NVIDIA 企业支持与服务的信息。本文档适用于 NVIDIA 的潜在和现有企业客户。本用户指南是非约束性文档,应用于获取有关 NVIDIA 企业品牌支持与服务的信息。

培训,使您的团队能够充分利用 DGX。

本课程旨在帮助 IT 专业人员成功管理 DGX SuperPOD 集群的各个方面,包括计算、存储和网络。

本课程概述了 DGX BasePOD 组件和相关流程,包括 NVIDIA DGX A100 系统;InfiniBand 和以太网网络;带内和带外管理工具;NGC;运行工作负载的基础知识;以及特定的管理工具和 CLI 命令。本课程包括根据您的特定 POD 解决方案的架构管理特定于供应商的存储的说明。

本课程概述了 DGX A100 系统和 DGX A100 工作站的带内和带外管理工具、运行工作负载的基础知识、特定的管理工具和 CLI 命令。

本课程概述了 Base Command Manager 解决方案。对于那些将要管理和使用 HPC 或 AI 集群的人员,本课程将帮助您抢先了解用于集群和工作负载管理的强大工具。

现场培训或通过 NVIDIA Academy WebEx 平台进行的讲师指导远程培训课程。两种方法都包括访问实践环境。

AI 基础设施与运维基础自定进度课程以及 NVIDIA 认证助理:AI 基础设施与运维认证考试的特价。